近期,科技巨头苹果公司被曝正全力推进其智能眼镜项目,计划在2026年底推出市场首款产品,此举被视为苹果在人工智能增强设备领域的又一重要布局。

据内部消息透露,苹果工程师团队正紧锣密鼓地研发这款智能眼镜,目标是在四年后将其推向消费者。与此同时,苹果已暂时搁置了开发内置摄像头的智能手表新版本的计划,以集中资源攻克智能眼镜的技术难关。

这款智能眼镜被定位为“基于AI的基础型可穿戴设备”,直接瞄准了市场上的同类产品,如meta的Ray-Ban智能眼镜和谷歌最新公布的Android XR眼镜原型。据称,苹果智能眼镜在设计上追求精致,将配备摄像头、麦克风阵列及微型扬声器,功能涵盖拍照、录像、实时翻译、导航、音乐播放及通话等。

用户可通过Siri语音助手与眼镜进行交互,设备还能根据用户所看到的景象提供即时反馈。尽管功能强大,但首批产品暂不支持增强现实(AR)功能。苹果计划在今年年底开始与海外供应商合作,大批量生产原型机,为后续的量产测试做好充分准备。

据参与测试的工程师透露,苹果智能眼镜在形态上与meta Ray-Ban智能眼镜相似,但在做工上更为精细。该项目的研发工作由苹果的Vision产品事业部主导,该部门此前已成功推出了Vision Pro产品。

值得注意的是,苹果在智能眼镜项目中将完全依赖自主研发的AI模型,而非像竞争对手meta和谷歌那样采用外部AI平台。然而,苹果内部研发团队对其AI技术储备表示了一定的担忧。目前,iPhone的视觉智能功能仍依赖谷歌和OpenAI的技术支持,而meta和谷歌的智能眼镜则基于各自的AI平台。为实现硬件自主化,苹果正加速开发替代方案。

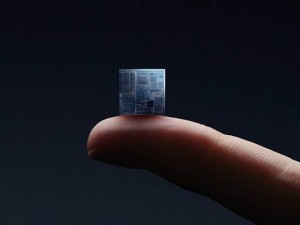

事实上,苹果近期已发布了一款专为Apple Silicon设备优化的视觉语言模型——FastVLM,提供0.5B、1.5B、7B三个版本。该模型能够在保持精度的同时,实现高分辨率图像的近实时处理,且计算量远低于同类模型。据技术文档显示,FastVLM的应用场景正是苹果正在研发的智能眼镜等穿戴设备。

随着苹果智能眼镜项目的不断推进,业界对其未来市场表现充满期待。这款集拍照、翻译、导航等多功能于一体的智能眼镜,能否在竞争激烈的市场中脱颖而出,让我们拭目以待。