当全球企业竞相将人工智能技术深度嵌入业务体系时,一个关键难题逐渐浮出水面——AI推理环节的延迟问题正成为制约技术落地的核心障碍。大型语言模型与多模态应用对即时响应的严苛要求,与中心化数据中心传输带来的物理延迟形成尖锐矛盾,这种"最后一公里"的瓶颈效应在自动驾驶、实时视频处理等场景中尤为突出。

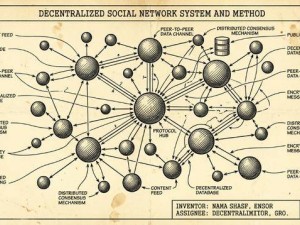

全球边缘计算领导者Akamai近日推出革命性解决方案AI Grid智能编排系统,通过将NVIDIA RTX PRO 6000 Blackwell服务器级GPU部署至全球4400个边缘节点,构建起覆盖130个国家的分布式推理网络。这项创新突破了传统AI架构"训练集中、推理集中"的物理局限,使推理任务能够在距离用户最近的节点完成处理,将游戏NPC交互延迟压缩至50毫秒以内,金融机构欺诈检测响应时间缩短至毫秒级。

市场调研数据显示,AI推理算力需求正呈现爆发式增长。Gartner预测到2028年,全球推理算力消耗将达到训练阶段的3倍;IDC则指出同期将有半数企业把推理服务部署在边缘侧。这种趋势倒逼技术架构革新,Akamai凭借二十年积累的分布式网络优势,将边缘节点从单纯的内容缓存站升级为具备完整推理能力的智能终端。

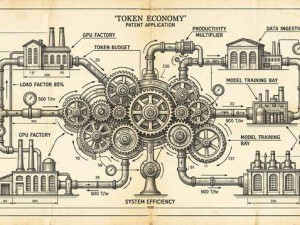

该系统的核心创新在于"Token经济"优化模型。AI Grid智能编排器如同精密的交通指挥系统,能根据任务特性动态匹配计算资源:对延迟敏感的轻量级推理直接在边缘节点完成,利用语义缓存和WebAssembly技术降低资源消耗;需要高密度计算的复杂任务则自动导向核心节点的专用GPU集群。这种分层调度机制使某美国科技巨头的整体推理成本降低37%,同时保证关键任务的QoS指标。

"中心化AI工厂适合训练前沿模型,但实时交互场景需要推理发生在数据产生的触点。"Akamai云技术事业部负责人Adam Karon解释道,"我们的分布式架构就像把超级计算机的算力分解成无数智能触角,既保留核心集群的规模效应,又获得边缘计算的即时性。"这种架构转型已产生实质性商业价值,该公司刚与某AI领军企业签署四年期2亿美元服务协议。

随着AI应用从生成式对话向物理世界代理演进,基础设施竞争焦点正从单纯算力堆砌转向智能调度能力。Akamai的实践表明,通过优化全球算力分布的"毛细血管",企业能在不增加中心投入的前提下,将AI服务转化为可实时访问的公共基础设施。这种转变或将重新定义数字经济时代的竞争规则——真正的技术优势不在于拥有多少服务器,而在于如何让每个计算单元产生最大协同价值。