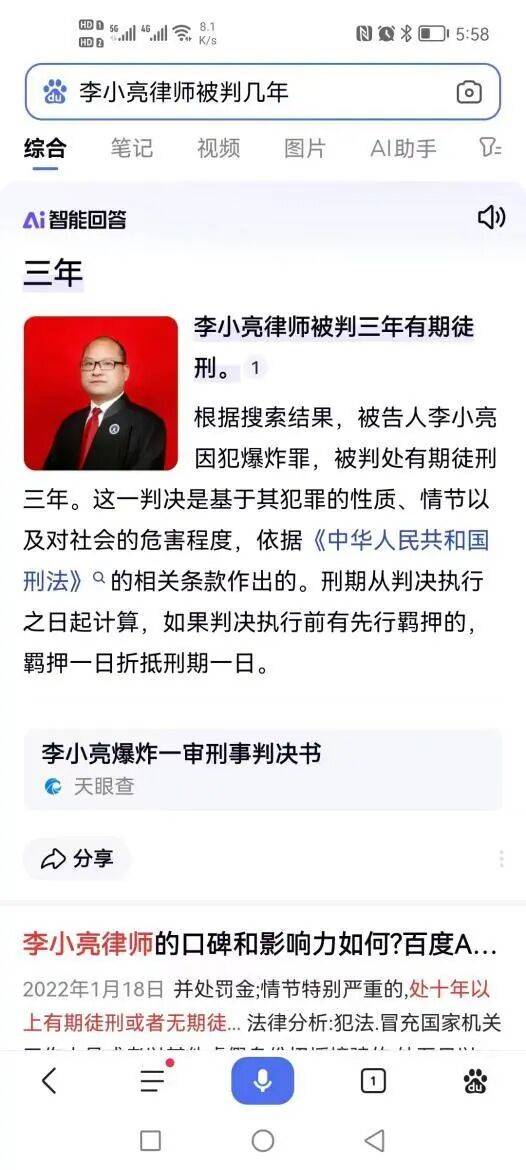

南京律师李小亮在搜索引擎上经历了一场荒诞的“名誉危机”。当他输入自己的姓名时,某搜索引擎的AI智能回答竟显示“因犯爆炸罪被判处有期徒刑三年”,并配上了他身着律师袍的照片。这一虚假信息并非偶然出现,即便李小亮多次通过律师函、投诉热线及邮箱向平台方反映,对方虽承诺处理,但核心谣言始终未彻底清除。直至起诉前,该平台仍会推送相关虚假内容。无奈之下,李小亮以名誉侵权为由将平台方告上法庭,要求删除不实信息、公开道歉并索赔。

庭审中,平台方辩称AI生成内容存在“幻觉”现象,属于技术发展的必然代价,且无法预见具体输出结果。然而,法官当场提出关键质疑:为何其他同类AI工具在相同关键词搜索下未出现类似诽谤内容?这一追问直指核心——问题并非技术不可控,而是涉事平台在内容审核机制上存在明显漏洞。法院最终判决认定,平台对特定自然人的诽谤性内容具有可预见性,未采取合理防控措施构成过错,需承担法律责任。

这起案件并非孤例。2025年5月,北京律师黄贵耕发现某搜索引擎AI生成多条关于他的虚假刑事指控,包括“威胁法官”“伪造印章”等,并被传播至其委托人及家属。他起诉后,平台方在庭审中仍以“AI无独立意志”“技术中立”等理由辩解,但同期其他AI工具均未输出类似内容。同年年底,河北男子冀承祥搜索姓名时,发现该平台AI将其真实求学经历与“组织卖淫罪”虚假信息关联,声称其被判刑五年六个月。

连续发生的类似事件暴露出涉事平台在内容风控上的系统性缺陷。法院在判决中明确划清界限:技术缺陷不能成为免责借口,平台对高风险内容负有主动审核义务。东南大学法学院专家指出,大语言模型的“幻觉”风险虽客观存在,但研发者需通过技术手段和人工审核相结合的方式建立防控机制,不能以技术之名规避责任。

涉事平台的AI业务在2025年已成长为营收核心,第四季度占一般性业务收入的43%。然而,其内容安全防线却屡现漏洞。从早年的医疗广告争议到如今的AI侵权纠纷,该平台多次将责任归咎于“商业逻辑”或“技术局限”。行业评论认为,AI竞争已进入下半场,参数规模等指标不再是关键,内容安全治理能力将成为决定企业长远发展的核心因素。当前,该平台AI营收与风控投入的失衡,正将用户信任危机转化为难以忽视的经营风险。