在近日举办的 Cloud Next '26 峰会上,谷歌正式推出第八代 TPU 架构,包含面向训练的 TPU 8t 与专注推理的 TPU 8i。这两款芯片预计于 2026 年晚些时候投入商用,目前采用申请制开放,Google Cloud 用户需通过官网提交使用需求。原生 PyTorch 对 TPU 的支持已进入预览阶段,谷歌正与特定合作伙伴及早期客户开展小规模测试,以优化算力资源分配策略。

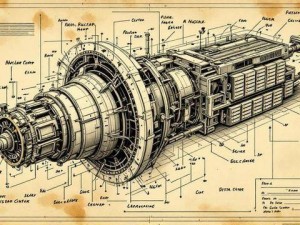

TPU 8t 的核心突破在于大规模训练效能的提升。通过搭载 SparseCore 专用计算单元与 Virgo 网络拓扑,该芯片将单位成本算力提升至前代的 2.7 倍。其 3D Torus 互联技术可组建超大规模计算集群——单个单元集成 9600 颗芯片,共享 2PB 内存,总算力达 121 ExaFlops。针对混合专家模型(MoE)的稀疏计算特性,SparseCore 技术优化了矩阵乘法单元的利用率,使芯片始终保持满负荷运转状态。数据传输方面,Virgo 网络将芯片间通信带宽翻倍,外部数据中心连接带宽提升四倍,配合 Direct Storage 技术绕过 CPU 直接读取高速存储,使训练速度提升十倍的同时,每瓦性能较前代提高两倍。

TPU 8i 则聚焦于实时推理与复杂决策场景。其配备的 288GB 高带宽内存与 384MB 片上 SRAM(容量为前代三倍),可将长上下文数据完整存储于芯片内部,显著减少外部内存访问频率。针对混合专家模型推理中的集体通信瓶颈,芯片内置的 CAE 加速引擎将延迟降低五倍,芯片间互联带宽增至 19.2 Tb/s。网络架构创新方面,Boardfly 拓扑借鉴 Dragonfly 设计思想,通过增加长距离直连链路,将 1024 颗芯片系统中的最远通信距离从 16 跳缩短至 7 跳,降幅达 56%。这些改进使 TPU 8i 的推理性价比较前代提升 80%,配合谷歌自研 Arm Axion 架构 CPU 的能效优化,可支持企业以相同成本服务近两倍用户。

谷歌此次全面开放第八代 TPU 使用权限,支持 PyTorch、JAX 等主流 AI 框架,开发者无需学习新编程语言即可调用算力。配套开源的参考模型代码库,进一步降低了技术门槛。从 Gemini 大模型到全球开发者的 AI 应用,这套架构正试图构建智能体时代的算力基础设施。其训练与推理芯片的分工设计,恰好契合了当前 AI 系统对算力与延迟的差异化需求——前者追求极致协同效能,后者强调快速响应与能效平衡。随着 TPU 8t 与 8i 的逐步落地,AI 从单一预测向场景模拟与深度推理的进化或将获得关键算力支撑。