在AI视频生成领域,一场关于技术路线的竞争正悄然展开。当多数企业聚焦于提升画面质量时,Anuttacon公司推出的LPM 1.0模型却选择了一条截然不同的道路——通过实现虚拟角色的长时间实时交互,为行业带来了新的可能性。这一突破不仅解决了传统模型在长程稳定性上的难题,更让虚拟角色从“复读机”进化为具有生命力的数字存在。

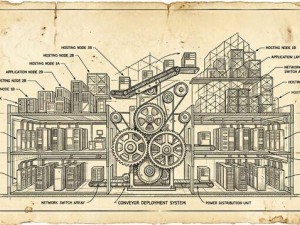

长期以来,AI视频生成领域存在着一个被称为“表演三难困境”的技术瓶颈:表现质量、实时推理和长程稳定性三者难以兼得。传统模型在生成超过30秒的视频时,往往会因微小误差的累积导致角色特征突变或动作不合理。而LPM 1.0通过引入在线流式生成架构,成功实现了“无限时长”视频生成——其官网展示的45分钟演示视频,便是这一技术突破的最佳证明。这种架构的核心在于将大型扩散模型压缩为“主干-精炼器”结构,前者负责稳定视频轨迹,后者则专注于还原高保真表情细节,从而在恒定内存占用下维持身份一致性。

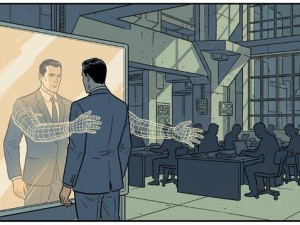

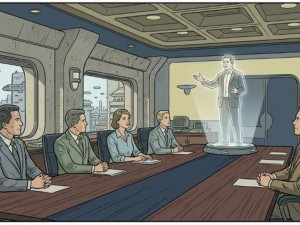

LPM 1.0的另一大创新在于全双工音视频对话能力。该模型能够同时处理两路音频流:一路用于驱动AI口型同步,另一路则实时分析用户语音的语气和停顿,进而生成点头、挑眉等微表情。这种设计让虚拟角色的交互不再局限于“说话”,而是能像人类一样根据对话情境做出自然反应。尽管在画面真实度上仍有提升空间,但这种长时间实时交互能力已足以让虚拟角色摆脱“机械感”,向真正的数字化生命迈进。

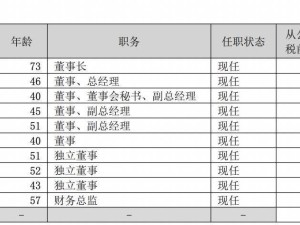

Anuttacon公司的技术路线,与其创始人蔡浩宇的背景密不可分。作为米哈游的前任董事长,他带领团队将游戏开发中的“人类表演学”经验转化为AI训练数据。例如,LPM 1.0采用的“身份感知参考图像管线”不仅需要照片,还需全局外观、多视角图像甚至8类预定义表情范例。这种高度结构化的“表演逻辑”数据,包含78种精细情感和超过5000个动作描述符,远超通用短视频平台从海量无标注视频中提取的特征。这种差异化的数据策略,让LPM 1.0在角色表现力上实现了电影级质感,成为其区别于Seedance 2.0等模型的核心优势。

然而,技术突破的背后是巨大的商业挑战。实时生成视频对算力的消耗极为惊人,尽管LPM 1.0通过优化让单GPU约0.35秒处理1秒视频,但在大规模并发场景下,硬件成本和运维压力仍不容小觑。Anuttacon此前推出的买断制游戏《星之低语》便是一个例证:这款以AI实时交互为核心的游戏虽定价33.99元并获得一定市场认可,但其对话仍存在上下文承接问题,且收入难以覆盖算力成本。这表明,直接面向C端的商业化模式在当前阶段仍面临考验。

相比之下,B端场景或许更能发挥LPM 1.0的价值。虚拟主播、AI导师、客服等领域对长时间稳定性的需求,与LPM的技术特性高度契合。相比雇佣人类,AI角色可实现7×24小时运行,且无需昂贵的动捕设备,综合成本优势显著。若将LPM作为UGC平台的基础设施,用户仅需提供照片和文本即可生成表演内容,将大幅降低创作门槛,推动互动媒体形式的革新。这种“降低专业门槛”的逻辑,与米哈游在游戏领域的成功经验一脉相承。

在AI视频生成领域,LPM 1.0的选择代表了一种新的技术哲学:与其在画质上与其他模型硬碰硬,不如深耕垂直场景,通过解决特定痛点建立壁垒。这种策略不仅体现了蔡浩宇对“体验”的深刻理解——在游戏领域,角色设定的任何“崩坏”都会破坏沉浸感;在AI领域,情感共鸣的缺失同样会引发“恐怖谷效应”——更揭示了实时生成的呼吸感和微表情,正在开启虚拟角色交互的新时代。尽管算力成本高昂,但只要能在高端互动叙事等领域形成不可替代性,掌握定价权便只是时间问题。